La recherche ne consiste plus à correspondre aux mots exacts que vous tapez.

Les moteurs de recherche modernes visent à comprendre ce que vous voulez dire, pas seulement ce que vous dites. Ce changement est grâce à quelque chose appelé Semantic Search.

C'est ce qui aide Google, Chatgpt et même les outils de recherche de site de base à fournir des résultats plus pertinents et significatifs.

Dans ce guide, nous décomposons ce qu'est la recherche sémantique et pourquoi c'est important – pas de jargon, pas de codage, tout simplement anglais.

Que signifie «sémantique»?

Le mot sémantique est tout au sujet du sens. Plus précisément, la sémantique est le domaine le plus concernant la façon dont les machines comprennent le sens des mots que nous utilisons et comment ces mots se rapportent les uns aux autres.

Il est facile de personnifier les machines et pense Ils comprennent des mots comme nous. Mais ils ne le font pas.

Les humains peuvent facilement comprendre que les mots chat, voiture et capuchon ne sont pas liés. Mais beaucoup doit se produire pour qu'une machine développe cette même compréhension. Jusque-là, ces trois mots sont des chaînes de personnages qui commencent exactement de la même manière.

Il s'agit d'une distinction vraiment importante pour les moteurs de recherche pour pouvoir faire parce que c'est ainsi qu'ils sont capables de montrer des résultats qui ont plus de sens pour les humains.

Qu'est-ce que la recherche sémantique?

La recherche sémantique est une méthode de récupération des documents et des informations qui ne sont pas basées sur la correspondance des mots exacts qu'un chercheur utilisés dans leur requête.

Il s'agit plutôt de comprendre l'intention et le sens du chercheur derrière ce qu'ils recherchent et de fournir la réponse qu'ils recherchent directement ou de leur rapprocher la solution idéale.

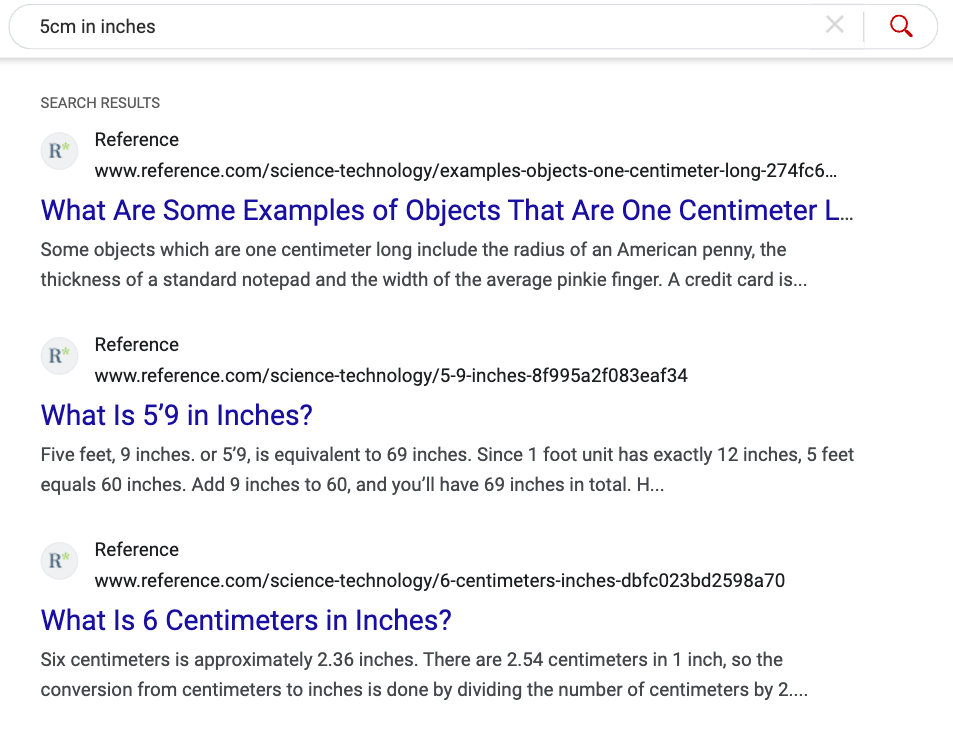

Par exemple, si vous recherchez quelque chose comme «5 cm à pouces», qu'est-ce qui est plus utile?

Résultats comme celui-ci, qui essaient de faire correspondre les mots de votre requête aux pages Web disponibles:

Ou des résultats comme celui-ci qui adaptent leur conception en fonction de la signification inférée de la requête (pour faire un calcul)?

Pour être clair, la calculatrice Google ajoute aux résultats de recherche ne le rend pas sémantique.

Au lieu de cela, la capacité de l'algorithme à comprendre que l'intention derrière la requête est d'effectuer un calcul est ce qui est sémantique. Il comprend la signification de la requête et montre des résultats plus pertinents.

Recherche sémantique vs recherche traditionnelle

Pendant longtemps, la plupart des moteurs de recherche ont fonctionné en faisant correspondre les mots exacts que vous avez recherchés aux documents qu'ils ont trouvés sur Internet. C'est un peu comme le fonctionnement de Google Scholar aujourd'hui:

Cette méthode de récupération d'informations ou de documents est appelée «recherche lexicale» car elle repose sur les mots exacts utilisés et affichera uniquement des documents qui mentionnent ces mots.

La recherche sémantique, en revanche, est plus libérale avec la façon dont il correspond à ce qu'un utilisateur recherche avec les documents qu'il peut retourner. Il essaie de comprendre le sens des mots recherchés.

Par exemple, Google Scholar a renvoyé un tas d'articles sur la condition exacte connue sous le nom de «maladie du foie». Mais l'article de premier plan sur Google (également l'article le plus cité dans la section des aperçus de l'IA) concerne les «problèmes hépatiques» plus généralement:

Les résultats mentionnent et mettent également en évidence des conditions connectées comme la cirrhose et l'insuffisance hépatique.

Dans le cas de la cirrhose, il n'y a pas de similitude «lexicale» (ou basée sur les mots) avec la «maladie du foie», c'est pourquoi les moteurs de recherche à l'ancienne n'apporteraient généralement pas de résultats à ce sujet.

Mais il y a une connexion basée sur le sens. La cirrhose est un concept étroitement connecté aux maladies du foie et c'est pourquoi les moteurs de recherche modernes qui adoptent une approche sémantique peuvent montrer des informations à ce sujet.

Comment fonctionne la recherche sémantique (en anglais simple)

Ainsi, en un mot, la recherche sémantique fonctionne en déterminant ce que vous voulez dire, puis en trouvant les résultats les plus pertinents en fonction de ce sens, pas seulement des mots que vous avez tapés.

Mais cela semble beaucoup plus simple qu'il ne l'est réellement.

Les systèmes de recherche modernes reposent sur un mélange de techniques qui les aident à interpréter le langage plus comme un humain. Voici quelques ingrédients clés qui le font fonctionner:

1. Traitement du langage naturel (PNL)

Le traitement du langage naturel est un domaine de l'informatique qui enseigne aux machines à lire, interpréter et générer un langage humain.

Il existe depuis les années 1950, et il se trouve maintenant sous l'égide de l'intelligence artificielle et de l'apprentissage automatique.

Certaines tâches majeures auxquelles PNL peuvent aider sont:

- Reconnaissance de la parole

- Classification de texte

- Comprendre le langage naturel

- Générer un langage naturel

Il est très pertinent pour le sujet de la recherche sémantique, car toutes les fonctions ci-dessus de la PNL sont un aspect central du fonctionnement de la recherche moderne.

La PNL aide à un moteur de recherche décomposer votre question en parties plus petites, à comprendre la structure des phrases et à reconnaître des choses comme les synonymes et les phrases courantes.

C'est ainsi que le système sait que «comment réparer un dos douloureux» et «Remèdes de la douleur au bas du dos» demandent la même chose.

2. Intention de recherche

Avant de vous présenter des résultats, les moteurs de recherche sémantique essaient de comprendre le pourquoi derrière votre requête.

Considérez-le comme la différence entre la recherche de «pomme» parce que vous voulez des fruits vs parce que vous recherchez l'entreprise. Ou, comme l'exemple «pouces aux centimètres» ci-dessus, en comprenant que vous voulez faire un calcul.

Cette compréhension de l'intention aide les résultats de tailleur du moteur de recherche qui répondent à votre question, même si vos mots étaient vagues ou peuvent avoir plusieurs significations.

3. Embeddings

Certains moteurs de recherche convertissent des mots, des phrases et même des documents entiers en intégres, qui sont comme des coordonnées dans une grande carte de sens.

Imaginez que chaque mot ou idée est un point sur une carte géante, où des idées similaires sont plus proches les unes des autres. C'est ce que sont les intégres.

Les moteurs de recherche et les LLM peuvent intégrer les sujets de votre requête de recherche ainsi que les documents qu'ils pensent être liés. Ensuite, ils vous montreront les résultats en fonction de ce qui est mappé le plus près de votre requête.

Cela permet au moteur de recherche de trouver des correspondances basées sur un sens, même lorsque les mots exacts ne correspondent pas.

4. Recherche de vecteur

Une fois que tout est placé sur cette «carte de sens», le moteur de recherche utilise la recherche vectorielle pour trouver la correspondance la plus proche. Pensez aux mathématiques du lycée – les vecteurs sont des lignes sur un graphique. Ainsi, la recherche vectorielle consiste à utiliser les lignes se connectant aux intégres pour voir à quel point ils sont proches ou éloignés les uns des autres.

C'est là qu'un tas de mathématiques et de calculs se produisent qui visent à répondre à la question: « Quels autres points sont les plus proches de celui qui vient d'ajouter? »

Cela signifie que vous pourriez rechercher «la médecine des brûlures d'estomac» et obtenir des résultats sur les «antiacides» ou le «reflux acide», même si ces mots n'étaient pas dans votre requête d'origine.

Un exemple populaire utilisé dans la communauté du codage pour expliquer cela est comment les machines font des mathématiques comme «King – homme + femme = reine»

(Source)

Les vecteurs permettent à une machine de voir que le roi est pour l'homme ce que la reine est à la femme.

Oui, cela semble étrange et contre-intuitif, et ce n'est pas du tout comment les humains pensent… ce qui est le point. Les ordinateurs ne peuvent pas penser comme les humains. Ils peuvent simuler Ça, mais ils ne peuvent pas réellement le faire, d'où tous les mathématiques.

5. Modèles d'apprentissage automatique

Au fil du temps, la recherche sémantique s'améliore en apprenant quels types de résultats que les gens trouvent utiles et ceux qu'ils ignorent.

Ce processus d'apprentissage l'aide à faire des prédictions plus intelligentes sur ce que les utilisateurs recherchent vraiment, même lorsque les requêtes sont désordonnées, mal orthographiées ou inhabituelles.

Il aide à penser aux machines dans les coulisses de l'apprentissage de la même manière que les enfants.

Ils sont exposés à un tas de données et essaient ensuite de le comprendre en catégorisant et en regroupant des choses similaires. Cependant, contrairement aux enfants, les machines «auront un sens» en créant des vecteurs et en exécutant des calculs (comme mentionné précédemment).

Ils le font afin de trouver la plus grande probabilité de choses qui appartiennent ensemble.

Plus deux fois, deux mots sont mentionnés ensemble, plus les chances sont liées. Plus les gens utilisent une séquence spécifique de personnages, plus c'est probablement un mot qui a un sens pour les humains, contrairement à une séquence aléatoire de personnages comme «SVXC», ce qui ne signifie rien pour nous.

6. Personnalisation et contexte

Parfois, la recherche sémantique prend en compte ce que vous avez recherché auparavant, votre emplacement ou d'autres signaux pour prédire ce que vous recherchez probablement. Dans le cas des LLM, ils peuvent également se souvenir de vos conversations passées.

Ils les incorpèrent. C'est ainsi qu'ils «se souviennent» que vous aimez un type particulier de résultat ou de sortie, donc une fois qu'il apprend ce modèle sur vous, un LLM modifie ses réponses pour vous donner ce qu'il pense que vous voulez.

Ce type de pertinence contextuelle aide également à affiner les résultats de recherche sur des plateformes comme Google afin que chaque utilisateur ait l'impression d'obtenir exactement ce qu'il voulait.

Comment la sémantique est utilisée par différents moteurs de recherche et LLM

La sémantique est utilisée dans la recherche de différentes manières. Chaque moteur de recherche et LLM possède ses propres algorithmes et modèles qui sont conçus de manière complexe par leurs équipes d'ingénierie.

Par exemple, le moteur de recherche Baidu utilise deux types d'index (un lexical et un sémantique) à partir desquels il tire les résultats de la recherche. Il s'agit d'une approche hybride qui permet aux utilisateurs de bénéficier de recherches de mots clés de correspondance exactes.

Pensez à la dernière fois que vous cherchiez une chanson et que vous avez entré une parole partielle dont vous vous souvenez. Ce type de recherche nécessite l'approche de correspondance lexicale de la vieille école pour qu'il retourne ce que vous recherchez (c'est-à-dire le reste de la chanson).

Google utilise également une approche hybride. Depuis longtemps, il utilise la vectorisation et également la sémantique entrelacée pendant la phase de reranking (l'étape juste avant qu'il ne montre les résultats à un utilisateur).

Mais les choses changent rapidement dans cet espace grâce aux LLM.

Les LLM s'affrontent vers la nature presque complètement sémantique, et comme les moteurs de recherche ajoutent plus de fonctionnalités basées sur LLM (comme les aperçus de l'IA de Google et le mode IA), c'est une réelle possibilité qu'ils puissent devenir encore plus sémantiques à l'avenir.